Du har en landing page. Den får trafik. En del besökare konverterar, de flesta gör det inte. Frågan är: skulle en annan version fungera bättre?

Det enda sättet att veta är att testa. Inte gissa, inte fråga en kollega, inte följa magkänslan. Testa.

Den här artikeln går igenom allt du behöver veta för att köra A/B-tester i WordPress – från vad som faktiskt spelar roll i en testplugin, till hur du sätter upp ditt första test, läser dashboarden, och förstår när resultaten är tillförlitliga nog att agera på.

Men först: vad ska du testa?

Den frågan är enklare än de flesta tror. Börja med din viktigaste sida – oftast den landing page som tar emot mest trafik eller som du lägger pengar på att driva besökare till. Testa en sak i taget: en annan rubrik, ett annat erbjudande, en annan layout, en annan CTA-knapp. Inte allt samtidigt. En förändring per test ger dig tydliga svar. Flera förändringar ger dig gissningar om vad som faktiskt gjorde skillnaden.

Vad som spelar roll i en A/B-testplugin

Alla A/B-testverktyg gör i princip samma sak: delar trafik, mäter konverteringar, visar resultat. Men hur de gör det skiljer sig – och skillnaderna spelar roll.

Server-side kontra JavaScript

Det här är den viktigaste tekniska distinktionen. JavaScript-baserade verktyg – som många SaaS-lösningar och gratisplugins använder – laddar originalsidan först, sen byter de ut innehållet med ett skript. Besökaren ser originalet i en bråkdel av en sekund innan den ”rätta” versionen visas. Det kallas flicker, och det är mer än en kosmetisk irritation. Det kan påverka både användarupplevelsen och testresultaten, eftersom besökaren redan har fått ett första intryck som inte stämmer med det de sen ser.

Server-side-testning löser det. Beslutet om vilken version besökaren ska se fattas innan sidan ens börjar ladda. Ingen flimmer. Ingen prestandapåverkan. Sökmotorer ser konsekvent innehåll.

I praktiken märks skillnaden direkt. Med en JavaScript-lösning ser en besökare din originalsida i kanske 200–500 millisekunder innan skriptet hinner byta ut den. Det låter kort, men det räcker för att hjärnan ska registrera en förändring. Det skapar ett subtilt obehag – något ”hoppade till” – som kan påverka hur besökaren uppfattar sidan, och i förlängningen testresultaten.

Vår plugin hanterar detta på den tidigaste möjliga punkten i WordPress laddningskedja – innan temat och andra plugins ens har hunnit köra. Besökare som tilldelas originalet märker ingenting alls, det finns ingen extra kod som körs. Besökare som tilldelas en utmanare redirectas omedelbart via en standard HTTP-redirect. Sidan de ser är den ”riktiga” sidan – inte en dynamiskt utbytt version.

Besökarspårning och deduplicering

Ett test där samma person räknas varje gång de besöker sidan ger missvisande data. Om du besöker din egen sida tio gånger och konverterar en gång, ser det ut som 10 besök och 1 konvertering – 10% konverteringsgrad. Men det var egentligen en person som konverterade. Det är 100%.

Deduplicering innebär att varje unik besökare bara räknas en gång, oavsett hur många gånger de kommer tillbaka. Det kräver en besöksidentifierare – i det här fallet en anonym cookie med ett slumpmässigt ID. Ingen persondata lagras, men pluginen vet att ”besökare X” redan har räknats.

Bot-filtrering

Sökmotorer, sociala medier-crawlers, SEO-verktyg och andra bottar kan generera hundratals ”besök” som aldrig var riktiga människor. Om de inte filtreras bort mäter du skräpdata.

Pluginen kontrollerar varje inkommande förfrågan mot över 70 kända bot-mönster – allt från Googlebot och Bingbot till AI-crawlers och övervakningsverktyg – innan den gör något annat. Matchade förfrågningar ignoreras helt. Ingen redirect, ingen cookie, inget registrerat besök.

Statistisk signifikans

Det kanske mest underskattade kravet. ”Version B har högre konverteringsgrad än version A” räcker inte. Frågan är om skillnaden är verklig eller bara slumpmässig. Det återkommer vi till i en egen sektion längre ner.

Vad som händer efter testet

Ett bra testverktyg hanterar inte bara testet – det hanterar också vad som händer efteråt. När en vinnare är vald ska all trafik gå till den vinnande sidan. Inga manuella redirects att sätta upp. Inga besökare som hamnar på den förlorande varianten.

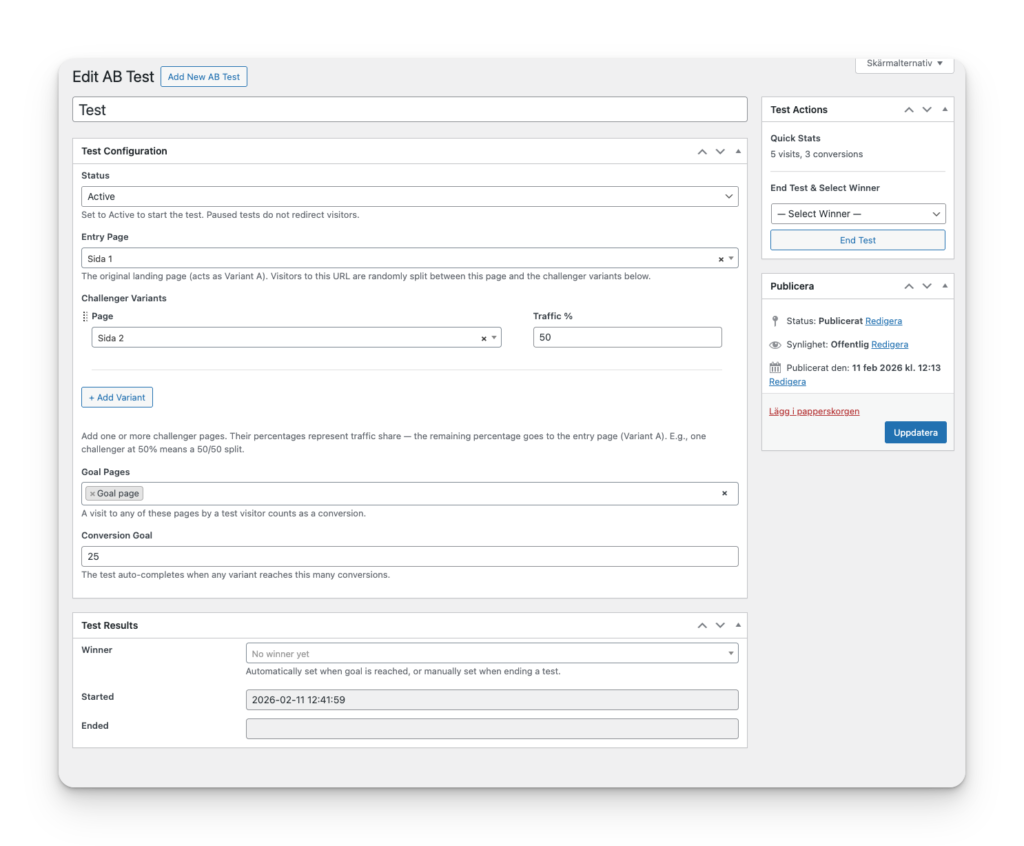

Så skapar du ditt första test

Processen ser ut så här:

1. Välj din entry page

Det är din nuvarande landing page – den sida besökarna landar på. Den blir automatiskt Variant A, originalet. All trafik som kommer till den här URL:en fångas upp av pluginen.

2. Skapa en eller flera challenger-sidor

Skapa en ny sida i WordPress med din alternativa version. Det kan vara en helt ny design, en annan rubrik, ett annorlunda erbjudande – vad du vill testa. Välj sen den sidan som challenger i testkonfigurationen och ange hur stor andel av trafiken den ska få.

Entry page får alltid det som blir över. Om du sätter challenger till 50% får originalet 50%. Om du har två challengers på 33% vardera, får originalet 34%.

3. Välj goal pages

En goal page är den sida som besökaren hamnar på efter en konvertering. Typiskt en tack-sida efter att de fyllt i ett formulär, bokat ett samtal, eller slutfört ett köp. När en besökare som ingår i testet besöker den här sidan räknas det som en konvertering.

Du kan välja flera goal pages – om du till exempel har olika formulär som alla leder till samma tack-sida, eller om konverteringen kan ske via olika vägar.

4. Sätt ett konverteringsmål

Konverteringsmålet är hur många konverteringar som krävs innan testet automatiskt avslutas. Den första varianten som når målet vinner. Om du vill avsluta testet manuellt istället kan du göra det när som helst.

Hur högt målet ska vara beror på din trafik. Tumregeln: sikta på minst 100 besök per variant innan du drar slutsatser. Med en 50/50-split betyder det minst 200 totala besök.

5. Aktivera testet

Sätt status till ”Active” och pluginen börjar dela trafik omedelbart. Inget mer att göra.

Tre exempelkonfigurationer

Enkel 50/50: Entry page (50%) kontra en challenger (50%). Det vanligaste upplägget. Bra när du vill ha resultat så snabbt som möjligt. Om du har 500 besökare i månaden kan du ha tillförlitliga resultat på 2–4 veckor, beroende på hur stor skillnaden mellan varianterna visar sig vara.

Trevägs-split: Entry page (34%) kontra två challengers (33% vardera). Användbart om du har två alternativa idéer och vill testa båda samtidigt. Kräver mer trafik för tillförlitliga resultat – räkna med att det tar ungefär dubbelt så lång tid som ett 50/50-test, eftersom varje variant får en tredjedel av trafiken.

Konservativt test (90/10): Entry page (90%) kontra en challenger (10%). Bra om du har en sida som redan fungerar bra och vill testa en förändring med minimal risk. Bara 10% av trafiken ser den nya varianten, så om den visar sig vara sämre påverkas nästan inga besökare. Nackdelen: det tar avsevärt längre tid att samla tillräckligt med data.

Vilken konfiguration du väljer beror på två saker: hur mycket trafik du har och hur stor risken känns.

Har du en nybyggd sida där allt är okänt? Kör 50/50.

Har du en sida som redan konverterar hyggligt och du vill experimentera med en ny rubrik?

90/10 ger dig trygghet medan du samlar data.

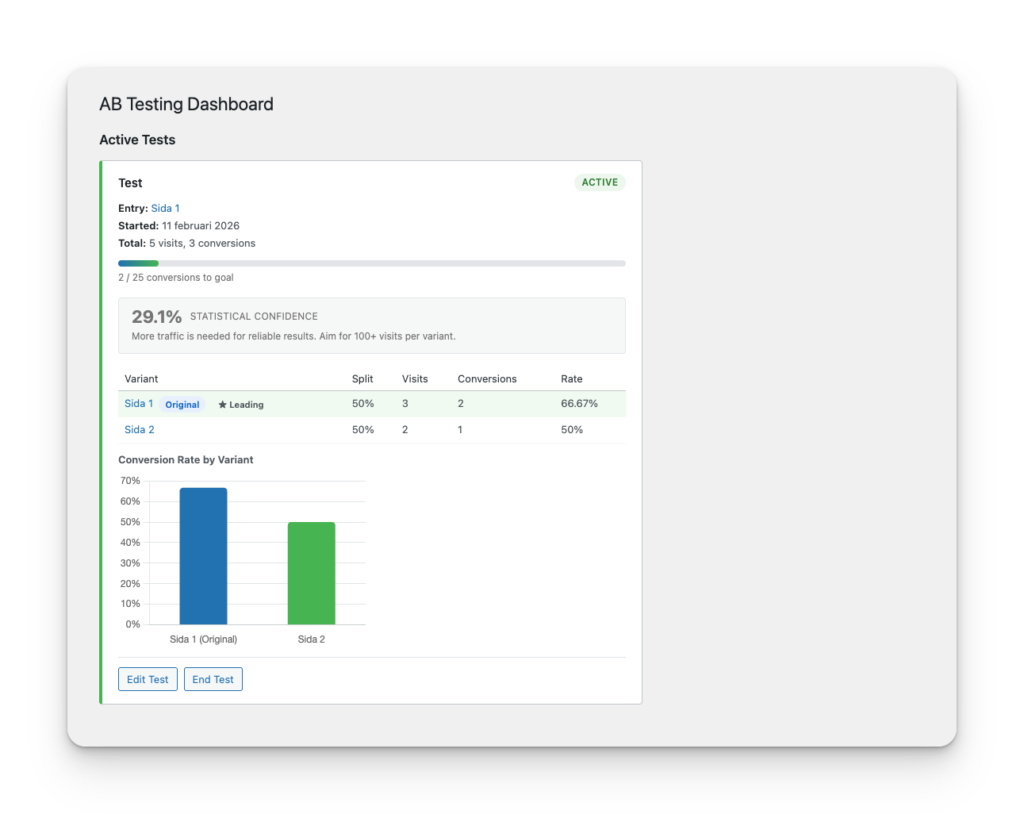

Dashboarden – vad siffrorna betyder

När testet är igång är dashboarden din enda kontaktpunkt. Allt du behöver se finns här.

Statusindikator

Visar om testet är aktivt, pausat eller avslutat. Ett pausat test slutar dela trafik men behåller all data.

Progress bar

Visar hur nära den ledande varianten är konverteringsmålet. Om du satte målet till 25 konverteringar och den ledande varianten har 12, ser du ”12 / 25 conversions to goal” med en bar som är ungefär halvfull.

Varianttabellen

Här ser du varje variants trafikandel, antal besök, antal konverteringar och konverteringsgrad. Den ledande varianten markeras med en stjärna.

Det som spelar roll är konverteringsgraden – procentandelen besökare som konverterade. Men en högre konverteringsgrad betyder inte automatiskt att varianten är bättre. Det beror på hur säkra siffrorna är. Och det är här konfidensindikationen kommer in.

Konverteringsgrafen

Stapeldiagrammet visar konverteringsgraden per variant visuellt. Det gör det lätt att se skillnader – men lita aldrig enbart på ögonmått. Titta på procenten för trygghet (confidence).

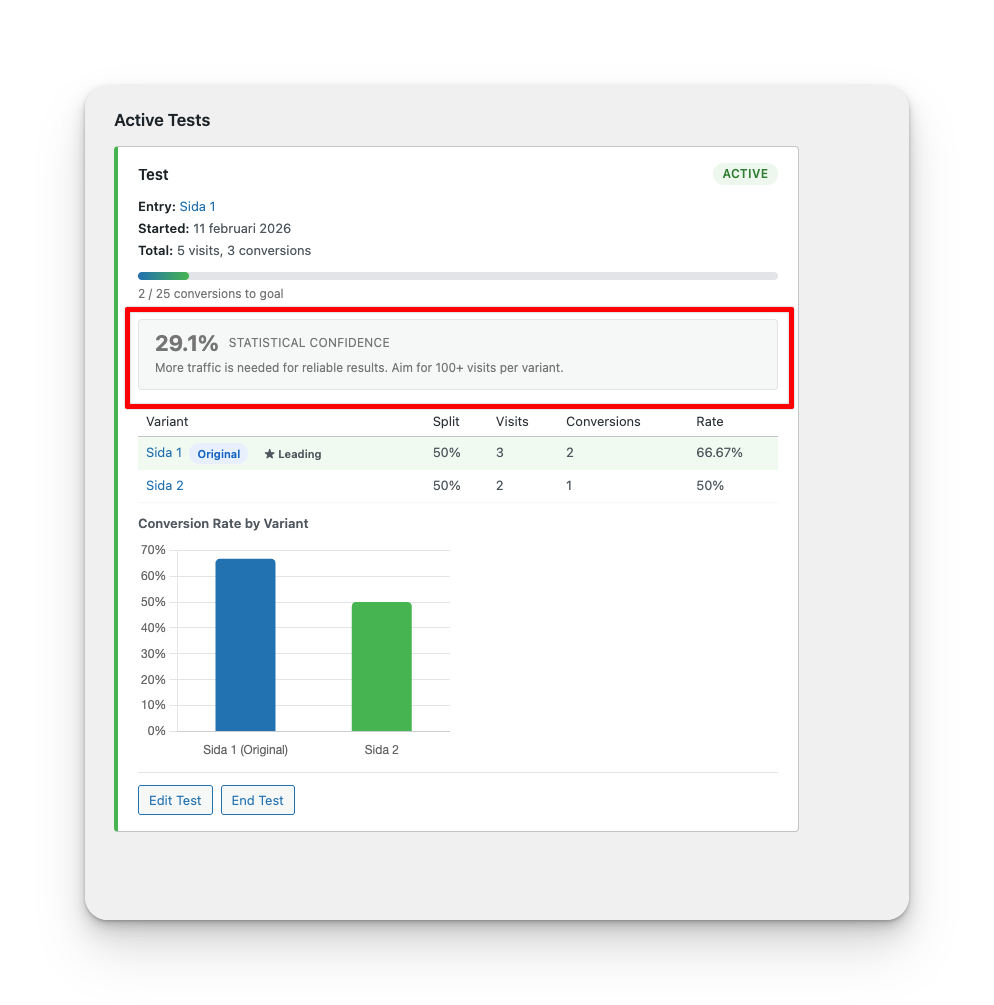

Statistisk signifikans – det viktigaste du behöver förstå

Det här är den del som de flesta hoppar över. Och det är den del som faktiskt avgör om ditt test betyder något.

Vad konfidensen betyder

Pluginen visar en statistisk konfidensprocent. Den svarar på frågan: ”Hur säkra kan vi vara på att skillnaden mellan varianterna är verklig, och inte bara slumpmässig?”

En konfidens på 95% betyder att om du körde samma test 100 gånger med samma förutsättningar, skulle du se samma resultat minst 95 av de gångerna. 95% är standardtröskeln inom A/B-testning och det som pluginen siktar på.

Vad färgerna betyder

Pluginen visar den statistiska övertygelsen med tre färger:

Grönt (95%+) – Statistiskt signifikant. Skillnaden mellan varianterna är med stor sannolikhet verklig. Du kan agera på resultatet.

Gult (80–95%) – På väg. Det finns en indikation, men det finns fortfarande en rimlig chans att skillnaden är slumpmässig. Fortsätt samla data.

Grått (under 80%) – Behöver mer data. Det är för tidigt att dra slutsatser. Siffrorna kan svänga kraftigt.

Varför litet sample size är farligt

Om du har 10 besök per variant och en konverterar i A men ingen i B, är konverteringsgraden 10% kontra 0%. Det ser ut som att A är klart bättre. Men med 10 besökare behöver det inte betyda någonting – nästa 10 besökare kan ge helt andra siffror.

Pluginen varnar dig om du har färre än 100 totala besök. Under den gränsen är siffrorna i princip meningslösa, oavsett vad konfidensberäkningen visar.

Vad du ska göra vid varje nivå

Grönt: Avsluta testet, välj vinnaren, kör nästa test.

Gult: Vänta. Du är nära, men ”nära” är inte tillräckligt. Ge testet mer tid och trafik.

Grått: Vänta definitivt. Ändra ingenting baserat på grå siffror. Om testet har kört länge och fortfarande är grått kan det betyda att skillnaden mellan varianterna är så liten att det inte spelar roll vilken du väljer – och det är också ett användbart resultat.

Under huven – varför det fungerar som det gör

Du behöver inte förstå tekniken för att använda pluginen. Men om du är nyfiken på varför saker fungerar som de gör, så här ser det ut bakom kulisserna.

Server-side redirect

Pluginen fångar upp förfrågningar på den tidigaste möjliga punkten i WordPress – innan temat, andra plugins, eller sidans innehåll ens har laddats. Beslutet om vilken variant besökaren får fattas omedelbart, och redirecten sker via en standard HTTP 302 (temporär redirect). Sökmotorer behandlar det korrekt.

Två cookies, ingen persondata

Två cookies hanterar besökarspårningen:

Den första lagrar vilken variant besökaren tilldelades, och gäller i 30 dagar. Den säkerställer att samma person alltid ser samma version under testets livstid.

Den andra är en anonym unik identifierare – ett slumpmässigt ID som genereras en gång per webbläsare och gäller i 365 dagar. Den används för deduplicering: att säkerställa att en besökare bara räknas en gång. Identifieraren hashas med SHA-256 och ett serverside-salt innan den lagras, så den är varken läsbar eller reversibel. Ingen persondata lagras någonsin.

Inloggade användare exkluderas

Om du är inloggad i WordPress – som admin, redaktör, eller vilken roll som helst – exkluderas du automatiskt från testet. Dina besök räknas inte, du får ingen cookie, och du ser sidan som vanligt. Det hindrar att din egen surfning förstör datan.

Vill du testa hur splittningen fungerar? Öppna ett inkognitofönster.

När testet är klart

Auto-completion

Om du har satt ett konverteringsmål avslutas testet automatiskt när den första varianten når målet. Vinnaren registreras, testet stängs, och all trafik börjar redirectas till vinnarsidan.

Manuell avslutning

Du kan alltid avsluta ett test manuellt – oavsett om målet har nåtts eller inte. Du väljer vilken variant som ska vara vinnaren via dashboarden.

Permanent redirect

Efter att testet avslutats byter pluginen från 302 (temporär) till 301 (permanent) redirect. Det betyder att alla URL:er som ingick i testet – inklusive entry page om den inte vann – pekar permanent på vinnarsidan. Det är bra för sökmotorer och besökare som bokmärkt en gammal URL.

Arkivet

Avslutade tester sparas i ett arkiv med fullständig statistik: varaktighet, antal besök och konverteringar, konverteringsgrad per variant, och vilken variant som vann. Du kan alltid gå tillbaka och se hur tidigare tester presterade.

Nästa test

Det bästa resultatet av ett A/B-test är inte en vinnare – det är ett nästa test. Du har lärt dig något. Nu kan du testa en ny hypotes mot din nya baseline.

Säg att du testade två rubriker och rubrik B vann. Nu är rubrik B din nya standard. Nästa fråga kan vara: spelar bilden roll? Behåll rubrik B och testa med en annan hero-bild. Eller testa en annan CTA-text. Varje test bygger på det föregående.

Det är inte en engångsgrej. Det är en process – och den fungerar bäst som en del av ditt löpande arbete med din digitala närvaro. Inte som ett stort projekt, utan som en vana. Kör ett test. Vänta. Titta på resultatet. Starta nästa.

Vad du ska testa (och i vilken ordning)

Om du aldrig har A/B-testat förut kan det vara svårt att veta var du ska börja. Här är en prioriteringsordning som fungerar för de flesta:

Rubrik och huvudbudskap. Det är det första besökaren ser. En starkare rubrik kan göra mer skillnad än någon annan enskild förändring.

Call to action. Vad du ber besökaren göra, och hur du formulerar det. ”Boka ett kostnadsfritt samtal” kontra ”Kom igång idag” kan ge helt olika resultat.

Sidlayout och struktur. Kort sida kontra lång sida. Formulär ovanför vikningen kontra längre ner. Testimonials kontra ingen social proof.

Erbjudande. Ibland är det inte sidan som är problemet – det är vad du erbjuder. Testa en annan ingång: en checklista istället för ett samtal, en gratis guide istället för en offertförfrågan.

Börja med det som är enklast att ändra och som har störst potentiell påverkan. Rubriken är nästan alltid rätt ställe att starta.

Sammanfattning

A/B-testning behöver inte vara komplicerat. Det du behöver är ett verktyg som delar trafik server-side, spårar besökare korrekt, filtrerar bort bottar, och ger dig en ärlig bedömning av om skillnaden du ser är verklig.

Sen behöver du tålamod nog att vänta tills siffrorna faktiskt betyder något. Det är den svåraste delen – inte tekniken, inte konfigurationen, inte tolkningen av dashboarden. Tålamodet att låta testet köra tillräckligt länge.

De flesta som börjar med A/B-testning gör samma misstag: de tittar på resultaten efter tre dagar, ser att en variant leder, och avslutar testet. Det är som att titta på en fotbollsmatch efter tio minuter och bestämma vinnaren.

Ge testet tid. Lita på konfidensindikationen. Och när du väl har ett resultat du kan agera på – agera. Implementera vinnaren, formulera nästa hypotes, och kör igen.

Det är ingen glamorös process. Men det är skillnaden mellan att veta vad som fungerar – och att hoppas att det gör det.